Parametry optyczne i wady układu optycznego

- APLIKACJE Parametry optyczne i wady układu optycznego

Odległość robocza (WD)

Odległość robocza, oznaczana jako WD oznacza odległość od próbki do czoła soczewki. Większa odległość robocza jest pożądana w aplikacjach wymagających manipulacji w próbce podczas realizowania obserwacji mikroskopem, a także w warunkach pracy mogących zaszkodzić soczewkom obiektywu (na przykład przy wysokiej temperaturze badanej próbki). W pozostałych zastosowaniach, korzystniejsza jest mała odległość robocza, pozwalająca na zmaksymalizowanie ilości światła dostarczanego do układu optycznego.

Apertura numeryczna (NA)

Apertura numeryczna (NA) jest właściwością fizyczną obiektywu, która jest częściowo zależna od jego średnicy (D) i odległości roboczej (WD). Jest to sinus maksymalnego kąta (wyznaczonego osią optyczną), pod jakim fala świetlna może padać na obiektyw lub z niego wychodzić.

Apertura numeryczna jest najważniejszym czynnikiem wpływającym na rozdzielczość obiektywu. Czym większa wartość apertury, tym więcej światła można wprowadzić do wnętrza kanału oraz tym większa jest realizowana rozdzielczość przy czym należy pamiętać, iż większa rozdzielczość wpływa na zmniejszenie odległości roboczej oraz głębi ostrości. NA wzrasta proporcjonalnie do rozdzielczości i odwrotnie proporcjonalnie do DOF oraz WD (NA wzrasta nieliniowo wraz ze wzrostem powiększenia).

Wartość apertury numerycznej możemy zwiększyć przez zmianę ośrodka przed obiektywem, z gazowego na ciekły. W tym celu, między próbkę, a obiektyw wprowadza się ciecz immersyjną o dużym współczynniku załamania, aby apertura była większa niż 1.

Rozdzielczość

Rozdzielczość wyrażana jest w Lp/mm. Określa ona ilość par linii rejestrowanych przez układ optyczny w polu o szerokości jednego milimetra. Pojedyncza para linii składa się z czarnej linii oraz z przestrzeni do niej przylegającej, która ma taką samą szerokość jak sama linia. Do określania rozdzielczości służą tabele wzorcowe.

Jeśli powiększenie jest większe niż maksymalne powiększenie korzystne (np. przy użyciu okularów 40x) obraz wydaje się nieostry, ponieważ ludzki wzrok jest w stanie zarejestrować więcej szczegółów niż zapewnia system optyczny. Gdy powiększenie jest mniejsze od maksymalnego powiększenia korzystnego, czynnikiem ograniczającym jest sam wzrok – wówczas oglądany obraz jest ostry i wyraźny.

| Rząd wielkości powiększenia | Rozdzielczość w płaszczyźnie xy | |

| Ludzkie oko | 1x | 0,2 mm |

| Szkło powiększające | 10x | 0,02 mm |

| Mikroskop stereoskopowy | 100x | 2 mm |

| Mikroskop | 1000x | 0,2 mm |

| Mikroskop elektronowy | 1000 000x | 0,2 nm |

Pole widzenia

Pole widzenia mikroskopu (FOV) to maksymalna powierzchnia widoczna podczas obserwacji przez okular mikroskopowy lub kamerę mikroskopową, zwykle podawana jako średnica zobrazowanego pola. Maksymalizacja pola widzenia jest pożądana w wielu zastosowaniach, ponieważ dzięki zwiększonej przepustowości uzyskuje się większą ilość zbieranych danych podczas pojedynczego pomiaru, co powoduje skrócenie czasu potrzebnego na pracę mikroskopu. Im większe jest pole widzenia, tym więcej można zobaczyć przy danym powiększeniu, jednak większe pole widzenia utrudnia korekcję płaskości całego widocznego obszaru.

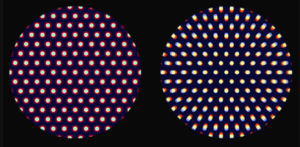

FOV mikroskopu jest definiowane przez szereg czynników, takich jak konstrukcja obiektywu, średnica wewnętrznego układu optycznego mikroskopu, parametry okularów, rodzaj mocowania kamery oraz rozmiar sensora zastosowanego w kamerze. Maksymalny FOV mikroskopu można wyznaczyć na podstawie numeru pola (FN) oznaczonego na okularach i obiektywach. Numer pola jest po prostu maksymalnym polem widzenia obiektywu lub okularu mierzonym jako średnica w milimetrach, przy braku powiększenia. Aby obliczyć rzeczywisty FOV, numer pola powinien być podzielony przez powiększenie obiektywu.

W mikroskopowych kamerach cyfrowych, używających sensorów kwadratowych oraz prostokątnych, niemożliwe jest pełne odwzorowanie pola widzenia przechwytywanego przez układ optyczny mikroskopu. FOV kamery, wyznaczany przez przekątną, musi być wpisany w FOV mikroskopu by móc wypełnić obrazem cały dostępny obszar. Gdy FOV kamery wykracza poza FOV mikroskopu, widoczne jest winietowanie w narożnikach obrazu przetwarzanego przez kamerę.

Aberracja chromatyczna

Elementy układu optycznego, takie jak soczewki obiektywu, generują podstawowe błędy w obrazowaniu, które można wyeliminować dzięki kombinacji soczewek pośrednich. Dwie typowe aberracje chromatyczne znane są pod nazwą:

- Osiowa aberracja kolorów (ACH) – różne długości fal są skupione w różnych pozycjach osiowych

- Trawersowa aberracja kolorów (TCH) – krawędzie obiektu pojawiają się w fałszywych kolorach i są wyolbrzymione.

Wady kolorów są szczególnie dokuczliwe przy obserwacji kontrastowych obiektów o bardzo ciemnych i bardzo jasnych miejscach.

Zastosowanie zaawansowanych układów optycznych sprawia, że zarówno błędy chromatyczne (ACH & TCH) jak i astygmatyzm są w pełni korygowane na obrazie pośrednim.

Z uwagi na różne sposoby korekcji, nie należy mieszać elementów optycznych pochodzących od różnych producentów.

Wady geometryczne

Znane również jako wady monochromatyczne, obejmują pięć składowych aberracji geometrycznych – aberracja sferyczna, koma, astygmatyzm, krzywizna pola oraz dystorsja. Ogólnie rzecz biorąc, aberracje geometryczne wynikają ze sposobu załamywania i odbijania światła podczas przechodzenia przez soczewki oraz ich struktury i geometrii.

Biorąc pod uwagę wszystkie fale świetlne, które mogą przechodzić przez zakrzywioną soczewkę, fale przechodzące przez środek zakrzywionej soczewki zostaną załamane w mniejszym stopniu niż fale przechodzące przez jej krawędzie. Fale świetlne, które przed przejściem przez soczewkę były równoległe, nie zbiegają się w jednym punkcie ogniskowym, lecz są rozpraszane jako różne punkty wzdłuż osi optycznej.

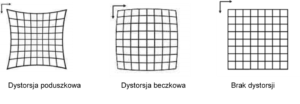

Dystorsja

Dystorsją nazywamy zniekształcenie obrazu występujące na krawędziach obserwowanego pola. Polega ona na różnym powiększeniu obrazu w zależności od jego odległości od osi optycznej. Podczas obserwacji prostokątnej siatki, zauważalna jest zmiana wzajemnego położenia linii, nadająca siatce kształt poduszki lub beczki, zależnie od rodzaju dystorsji – dystorsja beczkowa powoduje uwypuklenie środka kadru, natomiast dystorsja poduszkowa skutkuje jego zapadnięciem. Przyczynę zniekształcenia można zazwyczaj znaleźć w okularach.

Astygmatyzm

Astygmatyzm, powodujący zniekształcenie obrazu i spadek jego ostrości, wynika z ogniskowania promieni świetlnych dwóch prostopadłych płaszczyzn w różnych punktach powodującego różnicę w rozdzielczości struktur poziomych i pionowych. Astygmatyzm jest zwykle trudny do zaobserwowania.